生成AI時代の学びを守る:データセキュリティとプライバシー戦略

2026.04.27

生成AIが拓く学びのフロンティアと潜む影

こんにちは!AI時代の学びを追求するライター、本多です。最近、教育現場でも生成AIの活用が急速に進んでいますよね。個別最適化された学習プログラム、創造性を刺激するアイデア出し、そして探求学習の強力なパートナーとして、生成AIは私たちの学びを大きく変えようとしています。

私もEdTech企業のプロダクトディレクターとして、その可能性には日々ワクワクしています。AIを活用すれば、これまで画一的だった教育が、一人ひとりの興味や理解度に合わせてパーソナライズされ、子どもたちの「なぜ?」や「もっと知りたい!」という好奇心を無限に広げられるはずです。

しかし、その輝かしい未来の裏側には、避けては通れない重要な課題が潜んでいます。それが「データセキュリティ」と「プライバシー保護」です。生成AIが子どもたちの学習データを取り扱う以上、これらの課題にどう向き合い、どう解決していくかは、私たち大人に課せられた喫緊のミッションと言えるでしょう。

この記事では、生成AI時代の学びを安全に守るために、最新のデータセキュリティ技術やプライバシー保護戦略、そして国内外の具体的な取り組みについて、わかりやすく解説していきます。おうちでAI教育に取り組む子育て世代の方々も、学校現場で奮闘されている教育関係者の方々も、ぜひ一緒に考えていきましょう!

生成AIが教育現場にもたらすもの:光と影

生成AIが教育にもたらす「光」は計り知れません。例えば、

- 個別最適化された学習: AIが学習履歴や理解度を分析し、一人ひとりに最適な問題や解説を提供。

- 創造性の育成: アイデア出しのブレインストーミングパートナーとして、多様な視点や発想を提供。

- 探求学習の深化: 複雑なテーマでも、AIが情報収集や整理をサポートし、より深い学びを可能に。

- 言語学習の効率化: AIとの対話を通じて、自然な会話練習や発音チェックが可能に。

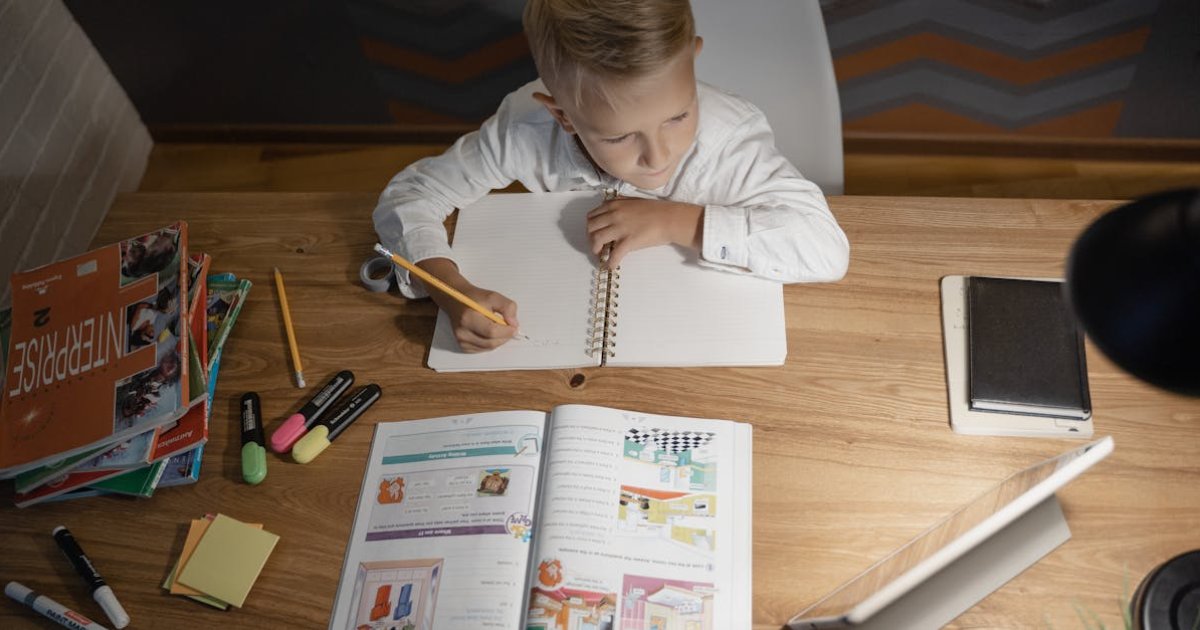

うちの上の子もマインクラフトにどっぷりハマっていて、最近は「プログラミングもやってみたい!」と言い出しました。彼がChatGPTに「どうやったらマインクラフトで自動で家が建つようになる?」なんて質問しているのを見ると、AIが学びの入り口を広げているのを実感します。

一方で、「影」の部分にも目を向ける必要があります。生成AIは、私たちの指示や質問、生成されたアウトプットなど、さまざまなデータを学習し、進化していきます。このデータには、子どもたちの個人情報や学習履歴、思考のプロセスといった、非常にデリケートな情報が含まれる可能性があります。

例えば、うちの下の子は、最近画像生成AIで「ユニコーンと虹の絵」を作るのが大好きなんです。毎日、いろんなユニコーンを生成しては、「これ、すごくない?」と私に見せてくれます。ある日、それを学校に持っていったら、先生の反応が少し微妙だったらしくて。「自分で描いた絵じゃないの?」というニュアンスを感じたみたいで、ちょっとシュンとしていました。

このエピソードは、AIの活用がまだ手探りな教育現場と、家庭でのAI利用との間に、少し温度差があることを示しているように思います。そして、この温度差は、AIが扱うデータの性質やその利用方法に対する理解度の差から生まれているのかもしれません。

なぜ重要?子どもたちの学習データとプライバシー

生成AIが教育現場で活用される際、最も懸念されるのが「データセキュリティ」と「プライバシー保護」です。では、具体的にどのような情報がリスクにさらされ、なぜその保護が重要なのでしょうか?

学習データに含まれるデリケートな情報

子どもたちの学習データには、単なるテストの点数以上の情報が含まれています。

- 個人情報: 氏名、生年月日、学年、住所など、個人を特定できる情報。

- 学習履歴: どの問題に時間をかけたか、どんな間違いをしたか、どんな質問をしたか、どんな回答を生成したか。

- 思考プロセス: AIとの対話履歴から読み取れる、子どもたちの興味、思考パターン、学習スタイル。

- 感情・心理状態: AIへの質問内容や表現から、子どもたちの感情や心理状態が推測される可能性。

これらは、子どもたちの成長をサポートする上で非常に貴重なデータですが、同時に悪用されれば大きなリスクとなりうる情報です。

データセキュリティとプライバシー保護を怠るリスク

もし、これらのデリケートな情報が適切に保護されなかった場合、どのようなリスクが考えられるでしょうか?

- 情報漏洩:

- サイバー攻撃などにより、個人情報や学習履歴が外部に流出し、悪用される可能性があります。

- 例えば、子どもたちの個人情報がフィッシング詐欺や不審な勧誘に利用される、といったケースも考えられます。

- 不適切なデータ利用:

- 学習データが、教育目的以外(例えばターゲティング広告や信用スコアリングなど)で利用される可能性があります。

- AIの学習データとして、意図せず個人情報が組み込まれ、その情報が一般公開されるリスクもゼロではありません。

- AIの「幻覚(ハルシネーション)」と誤情報:

- 生成AIは、時に事実とは異なる情報をあたかも真実のように生成してしまう「ハルシネーション」を起こすことがあります。

- 子どもたちがこれを鵜呑みにしてしまうと、誤った知識を身につけてしまうリスクがあります。

- AIのバイアス学習:

- AIが学習するデータに偏りがあると、性別、人種、文化などに基づく不公平な判断や差別的な出力を生み出す可能性があります。

- これは、子どもたちの価値観形成に悪影響を及ぼしかねません。

実は、うちの上の子が、ChatGPTに「宿題の答え教えて」と入力しているのを発見したことがありました。もちろん、AIは便利なツールですが、使い方を間違えれば「考える力」を奪ってしまいかねません。これをきっかけに、家族でAIの利用ルールをしっかり話し合い、「AIはあくまで道具。答えを出すのではなく、考えるヒントをもらうために使うこと」というルールを作りました。

このように、家庭でも学校でも、AIの特性を理解し、その利用における倫理観やルールを明確にすることが、子どもたちの学びとプライバシーを守る上で不可欠なのです。

教育現場で実践したい!データセキュリティとプライバシー保護戦略

では、具体的に教育現場ではどのような対策を講じれば良いのでしょうか。技術的な側面と、組織的・制度的な側面から見ていきましょう。

1. 技術的対策:データを守る「盾」と「鍵」

専門的な言葉が並びますが、身近な例えでイメージしてみてください。

- データの匿名化・仮名化:

- イメージ: 個人を特定できる情報を「モザイク」をかけたり、「ニックネーム」に置き換えたりして、誰の情報かわからないようにすること。

- 具体例: 氏名をID番号に変換したり、生年月日を学年情報のみにしたりする。

- データの暗号化:

- イメージ: 大切な手紙を「鍵付きの箱」に入れて送るように、データに「鍵」をかける技術。

- 具体例: サーバーに保存するデータや、ネットワークを通じてやり取りするデータを、第三者には読めない形に変換する。

- アクセス制御(最小権限の原則):

- イメージ: 大切な書類は、必要な人だけが、必要な範囲でしか見られないように「閲覧権限」を厳しく管理すること。

- 具体例: 教職員の中でも、担当者や役職に応じて、アクセスできる学習データの範囲を限定する。

- 差分プライバシー:

- イメージ: 大勢の意見を聞いて傾向を掴むとき、「誰が何と言ったか」は伏せて、「全体としてこういう傾向がある」という大まかな情報だけを出す技術。

- 具体例: 個人の学習成績を直接公開せず、クラス全体の平均点や学習進捗率などの統計情報として提供する際に、個人を特定できないよう「ノイズ」を加える。

- フェデレーテッドラーニング:

- イメージ: みんなで料理のレシピを開発するとき、各自が自分の家で試作し、その結果だけを共有し合って、最終的なレシピを完成させるようなイメージ。データそのものは家から持ち出さない。

- 具体例: 各学校やデバイス内でAIモデルを学習させ、その学習結果(モデルの重み)だけを中央サーバーに集めて統合することで、個人データが外部に出るリスクを減らす。

これらの技術は、データが外部に漏れるリスクを減らし、万が一漏洩しても個人が特定されにくいようにするための重要な「盾」となります。

2. 組織的・制度的対策:ルールと体制を整える

技術だけでなく、組織全体で取り組むべきこともたくさんあります。

- データガバナンスの確立:

- 学習データの収集、利用、保管、廃棄に関する明確なルール(方針)を定めること。

- 「誰が、どのような目的で、どのようなデータを、いつまで利用できるのか」を明確にします。

- セキュリティポリシーの策定と周知:

- 具体的な行動規範や手順をまとめたガイドラインを作成し、教職員全員に周知徹底すること。

- パスワード管理、不審なメールへの対処、データの持ち出しルールなど、具体的な行動を促します。

- 教職員への継続的な研修:

- AIの基礎知識、データセキュリティの重要性、個人情報保護に関する法規制などについて、定期的に研修を実施し、リテラシーを高めることが不可欠です。

- サービス提供事業者との契約見直し:

- AIサービスを提供する企業との契約において、データの取り扱い、セキュリティ対策、プライバシー保護に関する条項を厳しく確認し、必要に応じて交渉することが重要です。

- SLA(サービス品質保証)にも、データ保護に関する項目を含めるべきでしょう。

- 透明性の確保と説明責任:

- どのようなデータを収集し、どのように利用しているのかを、保護者や子どもたちに対して明確に説明できる体制を整えること。

- データ利用に関する同意を得る際も、わかりやすい言葉で丁寧に説明することが求められます。

これらの対策は、学校や教育委員会が一体となって進めるべきものです。

世界と日本のプライバシー保護の動き

データプライバシー保護は、今やグローバルな課題です。世界の主要な動きと、日本の取り組みを見ていきましょう。

海外の主なプライバシー保護法

| 法律名 | 対象地域 | 主な特徴 |

|---|---|---|

| GDPR | EU | EU一般データ保護規則。個人のデータ保護に関する権利を大幅に強化。同意の取得、データ主体の権利(アクセス権、消去権など)、域外適用(EU市民のデータを扱う企業はEU外でも適用)が特徴。世界中のプライバシー保護法のモデルとなっている。 |

| COPPA | 米国 | 児童オンラインプライバシー保護法。13歳未満の子どもからオンラインで個人情報を収集する際の保護者同意義務などを定める。子ども向けのWebサイトやオンラインサービスに特化した強力な保護法。 |

| CCPA/CPRA | 米国カリフォルニア州 | カリフォルニア州消費者プライバシー法/同プライバシー権法。GDPRに似た消費者のプライバシー権を保障。企業に対する情報開示義務や、個人情報の販売拒否権などを定める。 |

GDPRは、世界中のプライバシー保護法の「お手本」とも言える存在です。EU域内の市民のデータを扱う企業は、たとえEU域外の企業であってもGDPRの規制対象となるため、多くのグローバル企業が対応を迫られています。COPPAのように、子どもに特化した法律がある点も注目すべきです。

日本の取り組み

日本でも、個人情報保護法がたびたび改正され、プライバシー保護が強化されています。

- 個人情報保護法:

- 2022年4月1日に施行された改正法では、地方公共団体等に適用されていた条例による個人情報保護制度が、国や民間企業等と共通の制度に一元化されました。これにより、教育現場における個人情報保護の重要性がより一層高まっています。

- 個人情報の利用目的の明確化、安全管理措置、本人の権利強化などが定められています。

- 文部科学省のガイドライン等:

- 「教育データ利活用に関する検討会」: 教育データの効果的な活用と、プライバシー保護との両立を目指し、具体的な方策を検討しています。

- 「教育情報セキュリティポリシーに関するガイドライン」: 各教育委員会や学校が情報セキュリティ対策を講じる際の基本的な考え方や具体策を示しており、AI活用におけるデータ保護の基盤となります。

- 生成AIの教育利用に関する暫定的なガイドラインも発行されており、倫理的利用や情報セキュリティの確保が求められています。

これらの動きは、教育現場で生成AIを安全に利用するための法的・制度的な枠組みが着々と整備されつつあることを示しています。私たち大人も、これらの動向を注視し、積極的に情報を取り入れていく必要がありますね。

家庭でできる!AI時代のプライバシー保護教育

学校や制度の整備も大切ですが、私たち子育て世代の方々が家庭でできることもたくさんあります。

1. デジタルリテラシーの向上:AIを理解し、賢く使う力を育む

- AIの仕組みを理解する:

- 「AIって、どうやって動いているんだろう?」「私たちが入力した言葉はどこに行くんだろう?」といった疑問を、子どもと一緒に考えてみましょう。

- AIが「完璧な存在」ではなく、学習したデータに基づいて推論していることを教えることが大切です。

- 情報の真偽を見極める力:

- AIが生成した情報が常に正しいとは限らないことを伝え、「これ、本当かな?」と疑う目を養う練習をしましょう。

- 複数の情報源で確認する習慣をつけることが重要です。

- 個人情報の重要性を教える:

- インターネット上に一度公開した情報は、完全に消すことが難しいことを伝えましょう。

- 氏名、住所、顔写真、学校名など、個人を特定できる情報を安易に公開しないことの重要性を教えます。

2. 家族でAI利用のルール作り:対話から生まれる安全な使い方

うちの家族では、「AIを使う時間は30分、外遊びも30分セット」というルールを作っています。これは、AIの利用時間だけでなく、デジタルとリアルな体験のバランスも大切にしたいという思いから生まれました。

さらに、AI利用においては、以下のような具体的なルールを家族で話し合って作ってみましょう。

- 何を入力したらダメ?:

- 「自分の名前や友達の名前、住所、学校名などの個人情報は入力しない」

- 「悪口やいじめにつながるような言葉は入力しない」

- 「著作権のある画像や文章を無断で利用しない」

- 誰に情報を共有する?:

- 「AIが生成したものをSNSに投稿する前に、大人に相談する」

- 「AIとの会話履歴はプライベートなものとして、むやみに人に見せない」

- 利用時間や場所のルール:

- 「寝る前には使わない」「リビングで使う」など、各家庭に合ったルールを設定しましょう。

ルール作りは、一方的に押し付けるのではなく、子ども自身が「なぜこのルールが必要なのか」を理解し、納得することが大切です。家族会議のように、みんなで意見を出し合いながら作ると、より実効性のあるルールになります。

3. アプリやツールの選定:保護者の目線で安全性をチェック

AIを活用した教育アプリやツールを選ぶ際には、保護者の方がその安全性やプライバシーポリシーをしっかり確認することが重要です。

- プライバシーポリシーの確認:

- 「どのようなデータを収集しているのか」「そのデータをどのように利用しているのか」「第三者に提供されることはあるのか」などを確認しましょう。

- 子ども向けのサービスであれば、よりわかりやすい言葉で記載されているかどうかもポイントです。

- セキュリティ対策の確認:

- データの暗号化、アクセス制御など、どのようなセキュリティ対策が講じられているかを確認しましょう。

- 提供元が信頼できる企業であるかどうかも判断材料になります。

うちの配偶者はWebデザイナーなのですが、彼女はよく「このアプリ、子どもには使いにくいUI(ユーザーインターフェース)だね」とか「このプライバシー設定、もっとわかりやすくできないのかな」と冷静なフィードバックをくれます。プロの視点だけでなく、保護者としての目線も非常に重要だと感じています。使いやすさだけでなく、安全性も考慮して選ぶようにしたいですね。

まとめ:未来の学びを守るために、今できること

生成AIは、子どもたちの学びを豊かにし、無限の可能性を引き出す素晴らしいツールです。しかし、その力を最大限に活用するためには、データセキュリティとプライバシー保護という土台がしっかりしていることが不可欠です。

技術的な対策、制度的な整備、そして家庭での教育。これら三位一体の取り組みによって、私たちは子どもたちが安心して生成AIを活用し、創造性を育み、未来を切り拓く力を身につけられる環境を築くことができます。

AIは、私たち人類の知恵の結晶です。その知恵を、子どもたちの健やかな成長のために、安全かつ倫理的に活用していく責任が私たち大人にはあります。

ぜひ、この記事をきっかけに、ご家庭や教育現場でAIのデータセキュリティとプライバシー保護について話し合うきっかけにしていただけたら嬉しいです。未来の学びを、みんなで一緒に守っていきましょう!

関連記事

生成AI時代の学びの羅針盤:学習者のAIリテラシーを育む

生成AI時代の必須スキル、AIリテラシー教育の最前線。AI倫理、情報真贋、創造的活用スキルを育む国内外の最新動向と実践を解説します。

本多 誠 · 2026.05.15

本多 誠 · 2026.05.15

AIが教育評価を革新!多角的な視点で育む学習者の真の力

AIが従来のテストを超え、学習者のプロセスや成果を多角的に分析する最新動向を紹介。真の能力を引き出す評価の未来を探ります。

本多 誠 · 2026.05.14

本多 誠 · 2026.05.14

AI時代に求められる教師像:教員養成課程の最新動向

AIの進化が教育現場を変える中、未来の教育者に求められる資質やスキル、教員養成課程の最新トレンドを深掘り。

本多 誠 · 2026.05.13

本多 誠 · 2026.05.13